최근 AWS를 활용하여 엔터프라이즈급 AI 플랫폼을 설계하고 구축하는 기회가 있었습니다. 본 포스트에서는 다이어그램을 통해 설계한 아키텍처의 주요 구성 요소와 설계 의도를 공유하고자 합니다.

1. 전체 아키텍처 개요

1.1 멀티 계정 전략 (PRD/DEV 분리)

이 아키텍처의 목표는 엔터프라이즈 금융권 환경에서 AI Agent 기반 서비스를 안정적으로 운영하는 것이었습니다.

이를 위해 아래 네 가지 축을 중심으로 설계했습니다. 프로덕션과 개발 환경을 완전히 분리하여 운영의 안정성과 보안성을 확보했습니다.

- 멀티 계정 + 멀티 AZ 인프라

- PRD / DEV 계정 분리, 각 계정 내에서 2개 AZ 활용

- VPC, 서브넷, 보안 정책까지 환경별 완전 분리

- EKS 기반 컨테이너 런타임

- CPU 노드 / GPU 노드 / DB 서브넷 / Endpoint 서브넷 분리

- Agent 서비스, RAG 서비스, 관리 오퍼레이터 등을 각각 네임스페이스 단위로 분리

- AWS Bedrock 기반 RAG + Agent 오케스트레이션

- 문서 → 임베딩 → Vector 검색 → Bedrock LLM 응답까지 end-to-end 파이프라인

- Step Functions / EventBridge / SQS를 이용해 에이전트 간 플로우를 제어

- GitOps + 관측성(Observability)

- ArgoCD + CodePipeline/CodeBuild를 이용한 GitOps 배포

- Prometheus + Grafana + CloudWatch로 멀티 레이어 모니터링 구성

그림 1: PRD Account와 DEV Account를 분리한 멀티 계정 아키텍처

주요 특징

- PRD Account: 프로덕션 환경으로 고가용성과 확장성을 고려한 설계

- DEV Account: 개발/테스트 환경으로 비용 최적화를 위한 단일 노드/GPU 서버 구성

- Transit Gateway: 두 계정 간 안전한 네트워크 연결

- Direct Connect: 온프레미스 환경과의 전용 연결

1.2 온프레미스 연동

기존 온프레미스 인프라와의 하이브리드 클라우드 구성을 지원합니다.

그림 2: 온프레미스와 AWS 클라우드 간 통합 아키텍처

구성 요소

- Direct Connect: 전용 네트워크 연결

- Transit Gateway: 중앙 집중식 네트워크 허브

- Route 53: DNS 관리 및 라우팅

- On-Premise 데이터: 여신/대출 시스템, 업무 DB (IBIS) 등

2. AI 에이전트 오케스트레이션 아키텍처

2.1 에이전트 워크플로우

그림 3: AI 에이전트 오케스트레이션 워크플로우

데이터 플로우:

Application → API Gateway → Agent Orchestrator (Step Functions)

→ EventBridge/SQS → [Agent #1, Agent#2, New Tech Agent]핵심 구성 요소

- API Gateway

- 외부 요청의 진입점

- 인증/인가 처리

- 요청 라우팅 및 제한

- Agent Orchestrator (Step Functions)

- 워크플로우 오케스트레이션

- 에이전트 간 작업 조율

- 상태 관리 및 에러 핸들링

- EventBridge/SQS

- 비동기 메시지 큐잉

- 에이전트 간 이벤트 기반 통신

- 작업 분산 및 부하 분산

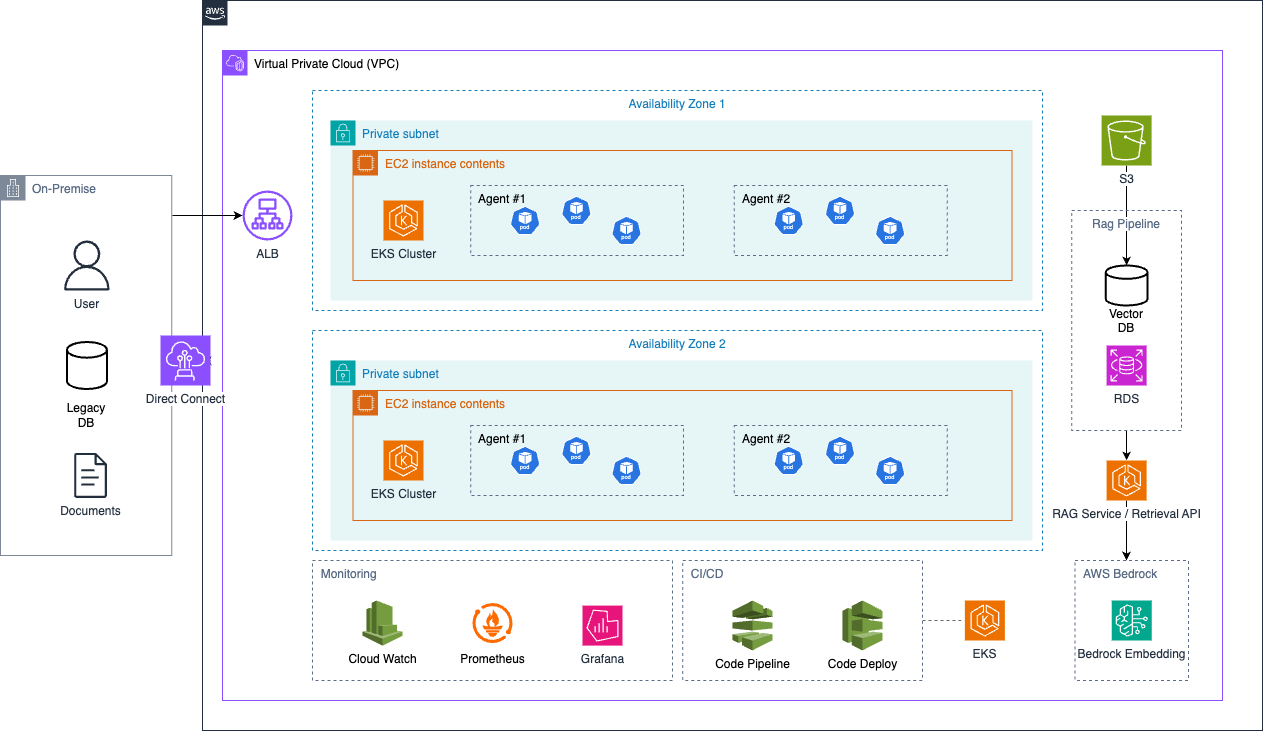

3. EKS 기반 컨테이너 인프라

3.1 고가용성 구성

두 개의 Availability Zone에 걸쳐 고가용성을 보장합니다.

그림 5: EKS 클러스터 고가용성 구성

네트워크 구성

- Private Subnet: 워커 노드 및 Pod 배치

- ALB (Application Load Balancer): 트래픽 분산

- EKS Cluster: Kubernetes 오케스트레이션

- Agent Pods: 각 에이전트를 Pod로 배포

서브넷 구조:

- Private lb subnet: 로드 밸런서 전용

- Node subnet: EKS 워커 노드

- GPU subnet: GPU 가속이 필요한 워크로드

- DB subnet: RDS, Redis Cache

- Endpoint Subnet: VPC Endpoint를 통한 AWS 서비스 접근

3.2 GitOps 배포 전략

ArgoCD를 활용한 GitOps 기반 배포 파이프라인을 구성했습니다.

그림 6: ArgoCD를 활용한 GitOps 배포

배포 프로세스:

- 코드 변경이 Git 저장소에 푸시

- ArgoCD가 변경사항 감지

- 자동으로 EKS 클러스터에 동기화

- 여러 서비스에 일관된 배포

4. RAG (Retrieval-Augmented Generation) 파이프라인

4.1 RAG 아키텍처

AWS Bedrock을 활용한 RAG 시스템을 구축했습니다.

그림 7: RAG 파이프라인 아키텍처

구성 요소

- S3: 원본 문서 저장

- RAG Pipeline

- 문서 처리 및 청킹

- 벡터 임베딩 생성

- Vector DB 저장

- Vector DB: 임베딩 벡터 저장

- RDS: 메타데이터 및 관계형 데이터

- RAG Service / Retrieval API: EKS에서 실행되는 검색 서비스

- AWS Bedrock

- Embedding Model: 텍스트를 벡터로 변환

- Converse API: 대화형 AI 인터페이스

- Rerank Model: 검색 결과 재순위화

4.2 데이터 플로우

문서 업로드 (S3)

→ RAG Pipeline (문서 처리, 임베딩 생성)

→ Vector DB + RDS 저장

→ RAG Service (검색 및 컨텍스트 생성)

→ AWS Bedrock (답변 생성)5. 모니터링 및 CI/CD

5.1 모니터링 스택

그림 8: 모니터링 스택 구성

모니터링 도구:

- CloudWatch: AWS 서비스 메트릭 및 로그 수집

- Prometheus: Kubernetes 메트릭 수집

- Grafana: 시각화 및 대시보드

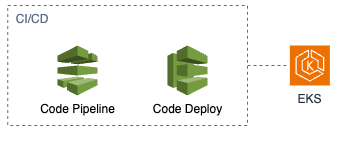

5.2 CI/CD 파이프라인

그림 9: CI/CD 파이프라인

구성 요소:

- CodePipeline: CI/CD 파이프라인 오케스트레이션

- CodeBuild: 소스 코드 빌드

- CodeDeploy: 배포 자동화

- EKS: 최종 배포 타겟

6. PRD vs DEV 환경 차이점

6.1 프로덕션 환경 (PRD)

- Multi-AZ 구성: 두 개의 Availability Zone에 걸친 고가용성

- Auto Scaling: 워크로드에 따른 자동 스케일링

- Multi-Instance: 여러 노드 및 GPU 서버 구성

- Enhanced Monitoring: 상세한 모니터링 및 알림

6.2 개발 환경 (DEV)

- Single Node: 단일 노드 사용으로 비용 절감

- Single GPU Server: 단일 GPU 서버로 개발/테스트

- Reduced Monitoring: 필수 모니터링만 구성

- Cost Optimization: 개발 환경에 맞춘 리소스 최적화

7. 보안 고려사항

7.1 네트워크 보안

- VPC 격리: PRD와 DEV VPC 완전 분리

- Private Subnet: 모든 워커 노드와 Pod는 Private Subnet에 배치

- VPC Endpoint: AWS 서비스 접근을 위한 프라이빗 연결

- Security Groups: 세밀한 네트워크 접근 제어

7.2 데이터 보안

- 암호화: 전송 중 및 저장 시 암호화

- Secrets Management: AWS Secrets Manager 활용

- IAM 역할: 최소 권한 원칙 적용

본 아키텍처를 통해 다음과 같은 경험을 얻었습니다.

- 멀티 계정 전략: 환경 분리를 통한 운영 안정성 확보

- AI 에이전트 오케스트레이션: Step Functions와 EventBridge를 활용한 유연한 워크플로우

- EKS 기반 인프라: 확장 가능하고 안정적인 컨테이너 플랫폼

- RAG 파이프라인: AWS Bedrock을 활용한 지능형 검색 및 생성 시스템

- GitOps 배포: ArgoCD를 통한 자동화된 배포 프로세스

이 아키텍처는 금융권 수준의 규제·보안 요구사항을 만족하면서 여러 도메인 Agent를 빠르게 추가·변경·배포할 수 있는 LLMOps 플랫폼을 목표로 설계했습니다.

온프레미스 시스템과의 하이브리드 연동, 멀티 계정/멀티 AZ, GitOps, RAG, Bedrock 등을 하나의 구조 안에 통합함으로써

“안정성·보안·확장성·운영 효율” 네 가지를 동시에 달성하고자 하였습니다. 앞으로도 이러한 설계 경험을 기반으로, 규제 산업 특성에 맞는 보안·거버넌스와 민첩한 AI 서비스 확장을 동시에 만족하는 LLMOps 아키텍처를 지속적으로 고도화하여, 엔터프라이즈 환경에서 신뢰할 수 있는 AI 플랫폼 운영 표준을 만들어가겠습니다.